Serveurs MCP et Apps SDK : l’«App Store» des IA est en marche

Sommaire

- Introduction

- Une révolution technologique dans la lignée de l’App Store ?

- Qu’est-ce qu’un serveur MCP ? Ou l’art de brancher une IA sur le monde réel

- Pourquoi tout le monde s’y met(tra) ? Un enjeu stratégique pour les plateformes IA

- Des cas d’usage déjà à portée de main

- Vers une expérience utilisateur réinventée (et proactive)

- Comment se préparer à la vague MCP ?

- Conclusion : il y aura un « tool » pour tout – et il est temps d’agir

Introduction

Nous vivons une époque où les innovations technologiques s’enchaînent à un rythme effréné. Il y a 17 ans, l’App Store d’Apple révolutionnait la manière de distribuer des applications mobiles : une nouvelle terre à conquérir pour de nombreux produits et services. Aujourd’hui, une transformation d’ampleur comparable s’annonce dans le domaine de l’intelligence artificielle générative. Son nom ? MCP, pour Model Context Protocol, plus communément appelés serveurs MCP ou connecteurs IA. Ces connecteurs pourraient bien devenir pour les IA ce que l’App Store fût pour le mobile : un écosystème foisonnant ouvrant la voie à de nouveaux usages et à de nouvelles sources de revenus.

Dans cet article, nous allons découvrir ce que sont les serveurs MCP, pourquoi ils représentent un tournant stratégique pour les plateformes d’IA (et pour les entreprises utilisatrices), et quels cas d’usage concrets s’offrent d’ores et déjà à nous. Nous verrons aussi comment ces connecteurs annoncent une expérience utilisateur renouvelée – plus fluide, plus proactive – et comment s’y préparer dès maintenant. Professionnel mais enjoué, cet article s’adresse en particulier aux product managers et aux décideurs qui souhaitent garder une longueur d’avance.

Une révolution technologique dans la lignée de l’App Store ?

Petit retour en 2008

À l’époque, l’iPhone venait d’avoir son App Store flambant neuf, offrant un portail unique pour télécharger des applications mobiles. BlackBerry régnait encore sur le marché du smartphone, mais Apple a su productiser une innovation (les applications mobiles) en un modèle économique durable et un réseau de distribution inédit. Le succès est fulgurant : un milliard d’appareils actifs et des dizaines de milliards de dollars de revenus générés via l’App Store en quelques années. Soudain, « il y avait une app pour tout ». Une nouvelle plateforme était née, apportant son lot de territoires vierges sur lesquels bâtir des produits et des services.

Fast-forward en 2025

Les modèles de langage (LLM) comme ChatGPT ou Claude ont atteint des centaines de millions d’utilisateurs actifs (on parle d’environ 700 millions d’utilisateurs hebdomadaires pour ChatGPT[1]) – du jamais vu pour un produit logiciel. Pourtant, la monétisation de ces IA reste en deçà de ce que l’on pourrait attendre d’une telle base installée (environ 13 milliards de dollars de revenus annualisés pour OpenAI, l’éditeur de ChatGPT[2]). En comparaison, Apple et Google tirent bien plus de valeur par utilisateur de leurs écosystèmes mobiles. Pourquoi un tel décalage ? Principalement parce que nos assistants IA actuels sont isolés : ils excellent à générer du texte, du code ou des images, mais opèrent encore en vase clos, sans lien direct avec nos outils quotidiens ou les services en ligne que nous utilisons.

C’est là qu’intervient la notion de plateforme IA. La concurrence actuelle entre acteurs de l’IA se joue beaucoup sur la performance des modèles (GPT-4 vs Claude vs Llama 2, etc.). Mais la prochaine bataille se livrera sur l’écosystème : autrement dit, la capacité à connecter ces modèles à tout ce qui nous entoure. Les serveurs MCP sont précisément la brique technologique qui permet ces connexions. Si l’on ose la comparaison, ils sont à l’IA ce que les applications furent au smartphone : un moyen d’étendre considérablement le périmètre des usages. À tel point que certains n’hésitent pas à parler d’un futur App Store des IA construit autour des connecteurs.

Avant de plonger dans les exemples concrets, clarifions ce qui se cache derrière l’acronyme MCP et comment cela fonctionne.

Qu’est-ce qu’un serveur MCP ? Ou l’art de brancher une IA sur le monde réel

Un serveur MCP (Model Context Protocol) est un connecteur standardisé qui permet à une IA (modèle de langage ou agent conversationnel) de se brancher sur des systèmes externes – qu’il s’agisse de bases de données, d’outils SaaS, d’applications internes, etc. Introduit en open source fin 2024 par Anthropic (l’éditeur de Claude)[3], ce protocole se veut universel et ouvert. Anthropic le décrit comme le « port USB-C » de l’intelligence artificielle[3], une métaphore parlante : de même que l’USB-C a unifié les connexions entre appareils électroniques, MCP vise à unifier la manière de connecter les IA aux diverses ressources numériques.

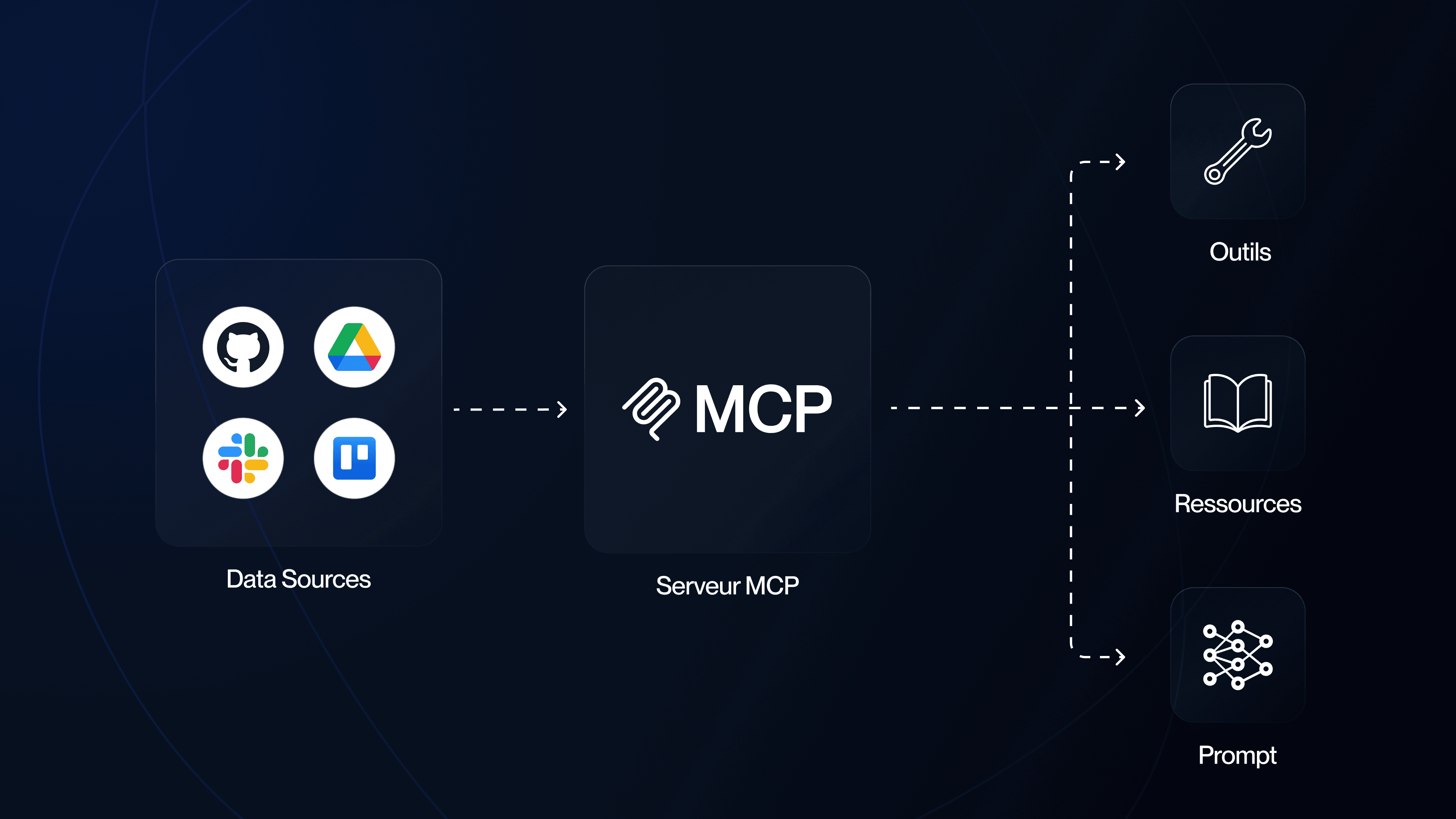

En pratique, un serveur MCP est une API (interface serveur) exposant certaines fonctionnalités d’un système sous une forme compréhensible par l’IA. Concrètement, un MCP permet d’exposer trois types de briques au modèle : -des Tools (outils permettant d’exécuter des actions) -des Resources (données renvoyant des informations structurées) -des Prompts (modèles d’instructions prêtes à l’emploi)[4]. Par exemple, un connecteur Gmail pourra offrir un Tool d’envoi d’email, tandis qu’un connecteur Google Drive pourra fournir une Resource permettant de rechercher et lire le contenu d’un document. Quant aux Prompts, ce sont en quelque sorte des scénarios pré-paramétrés qui guident l’IA dans certaines tâches complexes.

Le grand atout du protocole MCP, c’est que l’IA elle-même décide quand et comment utiliser ces connecteurs. Une fois qu’on lui a branché tel ou tel outil, le modèle saura de lui-même choisir le bon Tool au bon moment en fonction du besoin exprimé par l’utilisateur, sans intervention humaine supplémentaire. Cela confère une fluidité inédite : fini les copier-coller fastidieux entre ChatGPT et vos autres applications !

Scénario d’utilisation : Imaginons que je demande à mon assistant IA : « Envoie le rapport du T3 à toute l’équipe ». Naturellement, le modèle n’a pas ce rapport en tête. Grâce au connecteur MCP, il peut enchaîner plusieurs actions pour réaliser la tâche : d’abord utiliser le Tool find_file du connecteur Google Drive pour trouver le document, puis appeler le Tool send_email du connecteur Gmail pour préparer un email avec ce fichier en pièce jointe. En une seule requête en langage naturel, le résultat est atteint : mon mail est prêt à partir, sans que j’aie eu moi-même à fouiller dans Drive ni à ouvrir Gmail[5]. L’IA a orchestré le tout en coulisses, via des appels standardisés aux API de Drive et Gmail.

Ce qui était autrefois un bricolage (chaînes de prompts interminables, intégrations sur mesure pour chaque service) devient ainsi un processus fiable, standard et maintenable. Mieux encore, la sécurité y gagne : au lieu d’envoyer toutes vos données au modèle, le serveur MCP permet de filtrer et de ne transmettre que les informations strictement nécessaires. On peut héberger le connecteur dans son propre environnement, ce qui garantit que les données sensibles restent sous contrôle de l’entreprise tout en permettant à l’IA d’y accéder de manière ciblée[6].

En résumé, le MCP fournit aux IA universalité et contexte : n’importe quel service ou jeu de données peut devenir une extension de l’IA, de façon plug-and-play. Techniquement, il s’appuie sur des échanges en JSON standardisés (JSON-RPC) entre un client MCP (côté IA) et le serveur MCP (côté service externe). Mais pour le product manager ou l’utilisateur, ces détails s’effacent derrière une promesse simple : votre IA préférée va pouvoir utiliser vos outils préférés.

Pourquoi tout le monde s’y met(tra) ? Un enjeu stratégique pour les plateformes IA

On comprend l’intérêt du côté utilisateur, mais qu’en est-il du côté des grands acteurs de l’IA (OpenAI, Google, Anthropic, etc.) ? Pourquoi poussent-ils ces connecteurs MCP ? La réponse tient en un mot : économie.

Revenons à notre comparaison avec l’App Store. Apple ne s’est pas contenté d’améliorer l’expérience des utilisateurs d’iPhone en leur offrant des applications ; la firme a surtout créé un écosystème lucratif dont elle capte une part de la valeur. Chaque transaction sur l’App Store rapporte typiquement 15 à 30 % de commission à Apple, sans parler des frais facturés aux développeurs pour publier leurs apps et de la publicité sur la plateforme. Résultat : en 2022, l’écosystème App Store a représenté plus de 1000 milliards de dollars de ventes au total (tous secteurs confondus), dont environ 104 milliards sur les seuls biens et services digitaux[7][8]. Même si plus de 90 % de ces revenus bruts reviennent aux développeurs, cela laisse plusieurs dizaines de milliards dans les poches d’Apple chaque année. Leçon : contrôler la plateforme de distribution, c’est s’arroger une (grosse) part du gâteau.

Aujourd’hui, OpenAI et consorts sont dans une situation un peu paradoxale : leurs modèles sont massivement utilisés, mais la valeur créée s’échappe en grande partie hors de leur giron. Un exemple parlant : lorsqu’une entreprise intègre GPT-4 via l’API pour améliorer son application, OpenAI ne touche que les frais de calcul (les fameux tokens) – une somme souvent dérisoire comparée au prix de l’abonnement que l’utilisateur final paie pour l’application en question. De même, si vous utilisez un service mobile qui repose sur ChatGPT, Apple/Google prendra sa commission sur l’app, pendant qu’OpenAI ne percevra qu’un micropaiement pour les requêtes traitées en coulisses. Frustrant, non ?

Les serveurs MCP offrent aux fournisseurs d’IA une chance de renverser la vapeur. En attirant les utilisateurs sur leur propre interface (par ex. l’app ChatGPT ou Claude) pour y consommer différents services via des connecteurs, OpenAI et les autres peuvent enfin capter la valeur ajoutée. Comment ? De la même manière qu’Apple : en prenant une commission sur les transactions réalisées dans leur écosystème. D’ailleurs, OpenAI ne s’en cache pas : en septembre 2025, la société a lancé une fonctionnalité de paiement intégré baptisée Instant Checkout sur ChatGPT, en partenariat avec Etsy et Shopify, où « les marchands devront payer des frais à OpenAI sur chaque achat complété »[9][10]. La nouvelle a immédiatement été saluée par les marchés, les actions d’Etsy et Shopify ayant grimpé de 4 à 7 % suite à l’annonce[11][12]. C’est un signal clair : le commerce conversationnel arrive, et il ouvre un nouveau flux de revenus direct pour les plateformes d’IA.

Mais au-delà des transactions financières, se joue aussi la bataille de l’adoption. Historiquement, quand une plateforme offre aux développeurs un nouveau terrain de jeu, elle s’assure une avance durable. Microsoft l’a fait avec Windows, Apple avec l’App Store, Salesforce avec son AppExchange, etc. OpenAI, Anthropic, Google : chacun veut devenir le hub central où convergeront utilisateurs, développeurs et entreprises. Quitte à ce que, dans le futur, on n’aille plus sur le site web ou l’app mobile d’un service, mais qu’on passe par ChatGPT ou Claude pour y accéder… exactement comme on n’installe plus forcément le programme PC d’un service web, mais on passe par le navigateur.

En résumé, pousser les connecteurs MCP, c’est pour les géants de l’IA un moyen de fidéliser les utilisateurs (qui n’auront plus besoin de quitter la plateforme) et de monétiser ces usages tiers (via des commissions, de la mise en avant sponsorisée, etc.). C’est aussi une manière de rattraper un éventuel retard : une plateforme IA techniquement en deçà pourrait compenser en offrant l’écosystème de connecteurs le plus riche. À l’inverse, un champion actuel pourrait se faire détrôner s’il néglige cette dimension. L’histoire du tech regorge de dinosaures dépassés faute d’avoir pris le tournant d’une nouvelle vague… vous souvenez-vous de Nokia à l’ère post-iPhone ?

E-COMMERCE & RETAIL : COMMENT VENDRE AVEC LES IA CONVERSATIONNELLES ?

- Les tendances clés du commerce conversationnel et l’évolution des comportements d’achat

- Les protocoles MCP, Apps SDK et ACP et les nouveaux standards du web agentique

- Les risques à anticiper (contrôle, sécurité, dépendance plateforme) et leurs mitigations

- Des cas d’usage et des exemples d'architecture

- Une roadmap concrète pour passer d’un premier flux prioritaire à l’industrialisation

Des cas d’usage déjà à portée de main

D’accord, tout cela est prometteur sur le papier, mais concrètement, qu’est-ce qu’on va pouvoir faire de plus avec des serveurs MCP ? La réponse la plus honnête est probablement : une infinité de choses auxquelles nous n’avons pas encore pensé. Cependant, attardons-nous sur quelques exemples parlants – certains déjà en test, d’autres très facilement imaginables – qui montrent le potentiel de ces connecteurs dans divers secteurs :

Santé et bien-être :

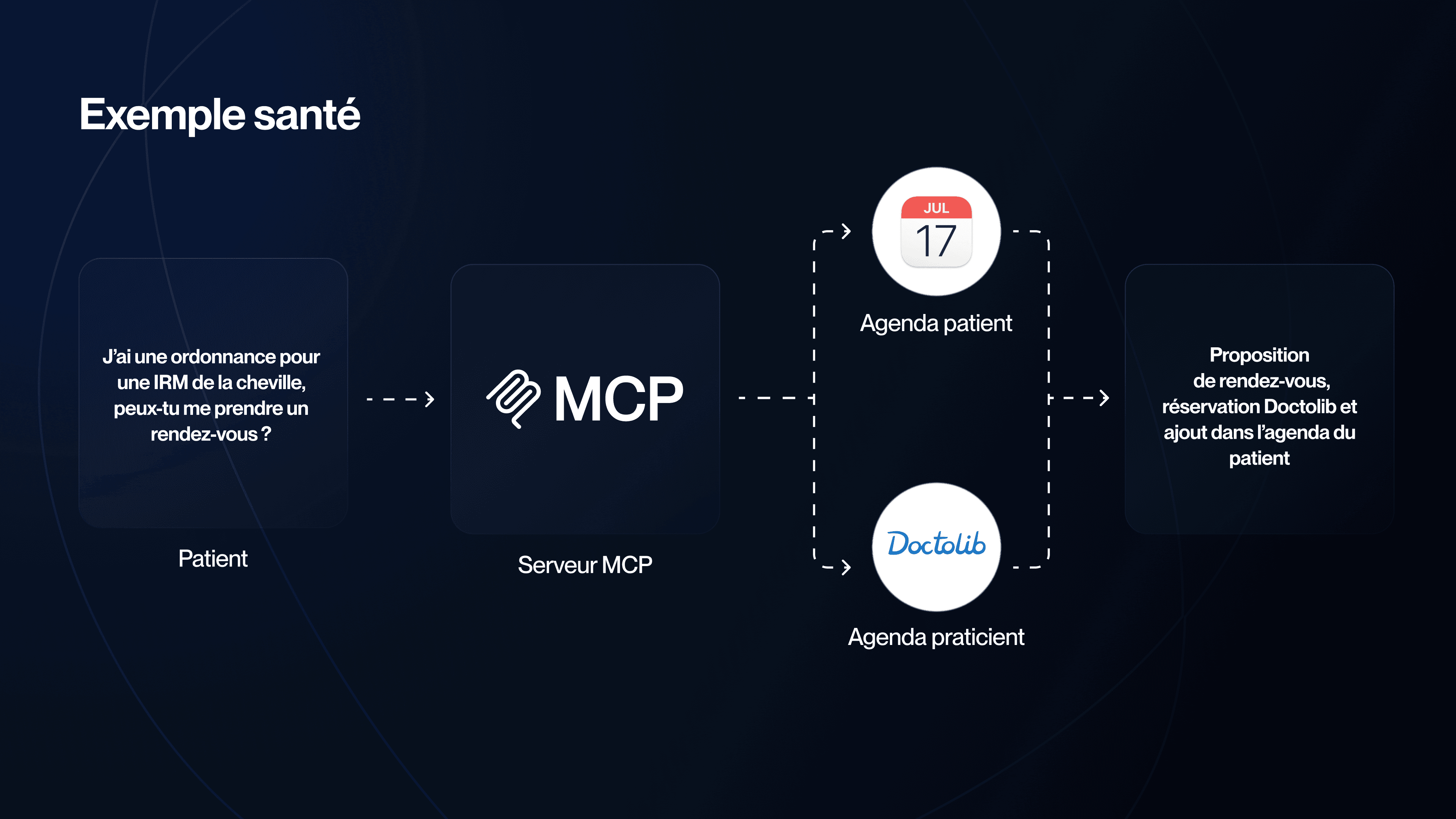

De nombreux particuliers utilisent ChatGPT ou Claude pour obtenir des informations médicales ou des conseils santé (avec toutes les précautions que cela suppose). Demain, un connecteur Doctolib (ou autre service de prise de rendez-vous médicaux) pourrait s’intégrer à l’assistant. Vous décrivez vos symptômes, l’IA vous répond mais vous suggère aussi « Et si on prenait rendez-vous avec un généraliste ? Dr Martin a des disponibilités lundi à 15h ». En une phrase, votre rendez-vous est pris, sans passer par l’appli ou le site externe. De même, un connecteur de télémédecine pourrait permettre à l’IA de déclencher directement une téléconsultation si nécessaire.

Voyage, loisirs et e-commerce :

C’est sans doute le domaine où l’on voit le plus l’intérêt immédiat.

Imaginez planifier vos vacances via une conversation naturelle : « Je cherche une destination en Europe du Sud, en famille, avec plage et visites culturelles, budget 2000€ ». L’IA pourrait faire appel à un connecteur Booking.com (ou Expedia, AirBnb…) pour comparer des offres, afficher quelques hôtels ou locations pertinentes avec photos, puis – une fois votre choix fait – réserver directement le séjour. Plus besoin de jongler entre dix onglets : l’assistant devient votre agence de voyage personnelle.

OpenAI a d’ailleurs commencé à déployer des fonctionnalités en ce sens : via Shopify et Etsy, ChatGPT peut désormais afficher des produits pertinents lors d’une recherche shopping et vous permettre de les acheter dans la foulée, paiement compris, sans quitter le chat[13][14]. Ce n’est que le début : d’autres partenaires rejoignent la danse, et les paniers multi-articles sont annoncés pour bientôt[15][14]. On peut facilement extrapoler à la réservation de billets de concert (via un connecteur TicketMaster), à l’achat de vêtements (connecteur Zalando ou Zara), etc. Votre assistant IA saura non seulement vous conseiller, mais aussi concrétiser vos achats* en quelques commandes vocales ou textuelles.

Grande distribution et alimentation :

Faire ses courses pourrait devenir nettement plus simple. Vous discutez recettes et menus de la semaine avec l’IA, qui vous génère la liste de courses optimisée. Un connecteur Carrefour ou Auchan prend alors le relais : en un clic (ou une phrase), votre panier est rempli sur le drive du supermarché, prêt à être validé. Terminé le temps passé à parcourir les rayons virtuels ; l’IA connaît vos préférences alimentaires et peut même vous suggérer des alternatives en cas d’indisponibilité d’un produit. Là encore, tout se passe dans la conversation.

Sport, éducation, productivité :

Les domaines ne manquent pas. Un coureur à pied pourrait demander un plan d’entraînement personnalisé ; son assistant irait puiser dans ses données Garmin (via un connecteur) pour connaître son niveau, puis créerait un programme adapté, synchronisé automatiquement avec sa montre connectée. Un étudiant pourrait utiliser un connecteur Wikipedia ou Bibliothèque universitaire pour obtenir des références vérifiées dans ses recherches, plutôt que de se contenter des connaissances internes du modèle. Un professionnel, enfin, verrait son assistant IA accéder à son calendrier, ses fichiers, Slack, etc., pour lui résumer les dernières actus de l’entreprise tous les matins et préparer les réunions à venir.

En un mot comme en cent : partout où il y a des données à aller chercher ou des actions à effectuer en lien avec un logiciel, un serveur MCP peut apporter de la valeur. L’IA devient un chef d’orchestre capable de coordonner une multitude de services pour nous rendre service, à nous.

Vers une expérience utilisateur réinventée (et proactive)

Intégrer des services externes à un agent conversationnel ne va pas seulement multiplier ses pouvoirs ; cela va aussi changer la façon dont nous interagissons avec lui. Jusqu’ici, ChatGPT et consorts s’exprimaient essentiellement en texte brut. Forts de leurs nouveaux connecteurs, ils pourront nous présenter de véritables mini-interfaces au sein même de la conversation.

Imaginez par exemple que vous cherchiez « les meilleures baskets de running à moins de 100€ ». Plutôt que de renvoyer une liste textuelle, l’assistant pourrait afficher un carrousel visuel de produits (photos, noms, prix) grâce à un connecteur e-commerce. Vous pourriez affiner votre choix via des boutons (par ex. trier par popularité, filtrer par pointure), puis appuyer sur « Acheter » directement dans le chat. C’est exactement le genre d’expérience qu’OpenAI a commencé à déployer avec son partenariat Shopify/Etsy : de la discussion au paiement en quelques taps, avec l’IA qui agit comme un personal shopper[16][17]. Pour l’utilisateur, c’est transparent et fluide ; pour le vendeur, c’est un canal de vente additionnel inespéré.

Au-delà de l’aspect visuel, ces plateformes conversationnelles vont devenir de plus en plus proactives. Un véritable assistant ne se contente pas d’attendre qu’on le sollicite : il anticipe vos besoins. Demain, votre agent intelligent pourrait vous envoyer des notifications le matin pour vous briefer sur les tâches importantes du jour :

« 🕘 Bonjour Céline. Vous avez 3 emails urgents (j’ai préparé des brouillons de réponse prêts à être envoyés), 2 réunions cet après-midi (voici les docs associés) et la météo annonce de la pluie – pensez à prendre un parapluie. Bonne journée ! ».

Ce scénario n’a rien de futuriste : techniquement, tout existe déjà pour le réaliser via des connecteurs (email, calendrier, météo…). Il suffit que l’interface le prenne en charge. D’ailleurs, certaines applications pionnières (Perplexity AI, par exemple) proposent des résumés quotidiens des actualités ou de vos flux d’information. Gageons que ChatGPT, Claude et les autres auront bientôt leur propre version du « morning brief » personnalisé.

En somme, grâce aux connecteurs MCP et à quelques évolutions d’interface, l’IA conversationnelle est en train de passer du stade de joujou sympa mais passif à celui de copilote intelligent et proactif. Cela pose bien sûr des questions en matière d’expérience (jusqu’où lui faire confiance ? comment éviter la sur-sollicitation ?) et d’éthique (comment garantir la neutralité des suggestions si des marques sont derrière certains connecteurs ?). Ces défis devront être relevés, mais ils ne freineront probablement pas l’adoption tant les bénéfices utilisateurs sont là.

Comment se préparer à la vague MCP ?

Pour les product managers et décideurs, la montée en puissance des serveurs MCP soulève deux grandes questions : « Notre produit doit-il rejoindre cet écosystème ? » et « Comment l’intégrer au mieux ? ». Voici quelques pistes de réflexion pour ne pas rater le coche de cette révolution naissante.

Évaluez la pertinence pour votre business

Tous les services ne se prêteront pas forcément à une intégration conversationnelle (du moins pas immédiatement). Analysez vos cas d’usage : votre application/projet repose-t-il sur des données ou actions qui pourraient être déclenchées par une simple instruction en langage naturel ? Si oui, un connecteur MCP apportera une vraie plus-value en éliminant des frictions pour l’utilisateur. À l’inverse, si votre valeur ajoutée tient surtout à une interface visuelle complexe ou à une expertise humaine, le MCP sera peut-être plus secondaire. Priorisez en fonction de l’impact potentiel.

Voyez le MCP comme un produit à part entière

Créer un serveur MCP, ce n’est ni plus ni moins que de développer une nouvelle interface vers votre service – au même titre qu’une application mobile ou une API publique. Cela mérite une réflexion produit dédiée : quelles fonctionnalités exposer ? Quels scénarios conversationnels soutenir ? Comment s’assurer que l’agent IA utilise au mieux votre outil ? Par exemple, un connecteur pour un service de réservation devra peut-être inclure une logique de recommandation ou de filtrage propre pour éviter de surcharger l’utilisateur de résultats non pertinents. Il faudra aussi penser sécurité et performance : limiter les appels ou les données renvoyées, gérer l’authentification des utilisateurs à travers l’IA, etc. La bonne nouvelle, c’est que développer un connecteur MCP est généralement plus léger que de coder une application native complète – on réutilise souvent les API existantes. Et comme le standard est ouvert, un même connecteur pourra fonctionner avec plusieurs IA (ChatGPT, Claude…), augmentant son ROI.

Surveillez l’évolution de l’écosystème

Nous sommes aux prémices du mouvement. Les connecteurs MCP sont encore cachés dans des menus expérimentaux, la documentation reste technique, les standards d’interface conversationnelle (boutons, listes, formulaires intégrés) commencent juste à émerger. Cette situation rappelle un peu le far west des débuts de l’App Store : un terrain vague à structurer. Attendez-vous à des changements rapides : terminologie (on parlera sans doute plus d’« outils IA » ou d’« apps conversationnelles » que de serveurs MCP à l’avenir), améliorations des SDK, apparition de places de marché de connecteurs bien intégrées dans les applications IA (imaginez une sorte de store où parcourir et installer en un clic les extensions disponibles pour votre assistant – c’est pour bientôt). Restez à l’affût des annonces des grands acteurs, et pourquoi pas contribuez aux communautés open-source qui façonnent le protocole.

Anticipez l’impact sur votre stratégie digitale

Si les assistants conversationnels deviennent une porte d’entrée majeure pour accéder aux services en ligne, il faudra peut-être repenser certaines priorités. Demain, « être bien référencé » pourrait signifier non seulement apparaître en tête de Google, mais aussi être le connecteur préféré d’une requête IA donnée. Cela pose la question du contenu fourni aux IA via vos connecteurs : un hôtel pourrait vouloir soigner la description qu’il expose à l’agent pour maximiser ses chances d’être recommandé. De même, la relation client/branding passera possiblement par l’IA intermédiaire : comment conserver votre identité de marque quand l’utilisateur interagit via ChatGPT ? Autant de sujets à intégrer dans votre réflexion stratégique dès maintenant.

En clair, si votre produit ou service parle IA (ou plutôt parle à l’IA), il restera dans la course. Sinon, il risque de paraître rapidement dépassé aux yeux d’utilisateurs habitués à tout faire converser avec leur assistant intelligent.

Conclusion : il y aura un « tool » pour tout – et il est temps d’agir

En 2008, la devise officieuse du mobile était « There’s an app for that! » (il y a une application pour ça). En 2025, nous pourrions bien dire de plus en plus : « Il y a un outil IA pour ça ». Les serveurs MCP ouvrent la voie à un monde où chaque service digital peut devenir une pièce du puzzle de notre assistant personnel. C’est une évolution passionnante qui va simplifier bien des usages et en créer de nouveaux.

Pour les entreprises et les visionnaires produit, c’est le moment ou jamais de se lancer. Comme pour la ruée vers le mobile ou le cloud en leur temps, les premiers arrivés seront les premiers servis. Créer un connecteur MCP pour votre service, c’est l’opportunité d’être aux avant-postes de la prochaine vague technologique, d’apprendre vite, et pourquoi pas de prendre une longueur d’avance sur vos concurrents moins agiles.

Chez BeTomorrow, nous suivons de très près ces évolutions et aidons déjà nos clients à en tirer parti. Vous vous interrogez sur les possibilités offertes par les connecteurs MCP dans votre secteur ? Vous envisagez de développer un serveur MCP pour votre produit et vous voulez être accompagnés par des experts à la fois techniques et métiers ? Contactez-nous dès aujourd’hui ! Nous serons ravis d’imaginer avec vous des solutions innovantes pour intégrer vos services à l’écosystème IA de demain, et faire en sorte que votre entreprise profite pleinement de cette révolution en marche. Ensemble, préparons dès maintenant le terrain de vos succès futurs – dans un monde où l’intelligence artificielle, plus connectée que jamais, fera partie intégrante du quotidien de vos utilisateurs.

Sources : OpenAI, Anthropic, Reuters, VentureBeat, La Revue IA[2][9][4][5] (voir liens pour plus de détails).

[1] [2] ChatGPT rockets to 700M weekly users ahead of GPT-5 launch with reasoning superpowers | VentureBeat

[3] [4] [5] [6] Comprendre le protocole MCP (Model Context Protocol) - La revue IA

https://larevueia.fr/comprendre-le-protocole-mcp-model-context-protocol/

[7] [8] Developers generated $1.1 trillion in the App Store ecosystem in 2022 - Apple

[9] [10] [11] [12] OpenAI partners with Etsy, Shopify on ChatGPT payment checkout | Reuters

[13] [14] [15] [16] [17] Buy it in ChatGPT: Instant Checkout and the Agentic Commerce Protocol | OpenAI